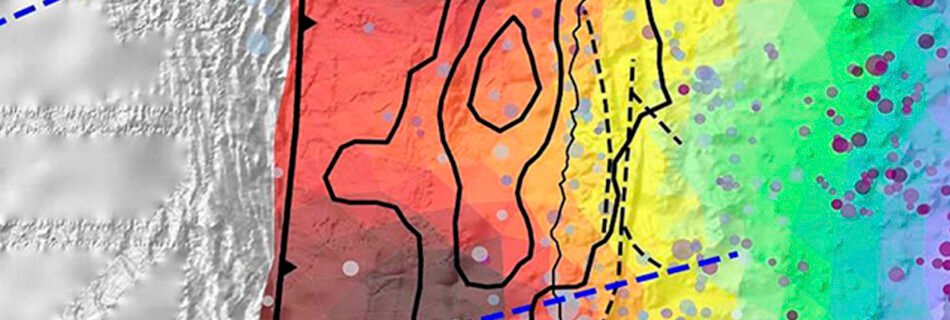

Un nuevo método para estimar el grado de acoplamiento o potencial sísmico a lo largo de la interfaz de las placas tectónicas de Nazca y Sudamericana, entre las ciudades de Antofagasta y La Serena, desarrollaron los investigadores del Departamento de Geofísica (DGF) de la Universidad de Chile, Francisco Ortega Culaciati y Vicente Yáñez Cuadra. El trabajo, publicado por la revista Geophysical Research Letters, busca contribuir a un estudio más detallado del peligro sísmico en Chile.

“Calcular el acoplamiento entre placas tectónicas es un desafío que se aborda como un problema inverso porque, pese a ocurrir a decenas de kilómetros de profundidad, se debe estimar a partir de mediciones de movimientos en la superficie de la tierra”, explicó el académico de la Facultad de Ciencias Físicas y Matemáticas y coautor del estudio, Francisco Ortega Culaciati, sobre esta propuesta que plantea un cálculo conjunto de un nuevo modelo de acoplamiento del margen de subducción chileno y de la deformación y rotación de la placa continental Sudamericana.

El profesor de la Universidad de Chile argumentó que esta tarea suele ser especialmente compleja, no solo porque las observaciones contienen ruido, sino también porque su análisis debe considerar los efectos de los movimientos de los grandes terremotos y de procesos tectónicos y geológicos, como el acoplamiento entre placas tectónicas, la rotación y traslación de microplacas tectónicas, las deformaciones en el manto terrestre; y el alzamiento de la cordillera de Los Andes.

“Si bien investigaciones anteriores habían modelado el acoplamiento entre placas tectónicas en conjunto con la microplaca tectónica de los Andes como macizo rígido, estudios posteriores comenzaron a plantear ciertas limitaciones en esta hipótesis”, afirmó el profesor Ortega Culaciati. De esta manera, a través de herramientas matemáticas y computacionales de última generación, los investigadores se propusieron abordar el problema mediante un análisis del grado de acoplamiento de las placas de Nazca y Sudamericana que considerara una componente de deformación sumada al movimiento rígido continental.

“Durante este proceso fue necesario realizar numerosas pruebas y comparar los resultados que íbamos obteniendo con los de otras metodologías para poder respaldar con argumentos físicos y matemáticos que, efectivamente, nuestra propuesta era mejor”, sostuvo el investigador del DGF y del proyecto PRECURSOR, Vicente Yáñez Cuadra. Como resultado, se obtuvo un modelo de acoplamiento de la zona de estudio “estadísticamente significativo y bastante más robusto que los obtenidos hasta ahora, ya que permite interpretar de mejor manera cómo se acumula la energía que eventualmente se libera durante un gran terremoto”, añadió el egresado del Magíster en Ciencias con mención Geofísica, Vicente Yáñez Cuadra.

Entre los hallazgos más importantes del estudio, ambos investigadores destacaron la alta acumulación de energía sísmica que existiría en la zona más somera del contacto entre placas tectónicas frente a las costas de Antofagasta (sobre el área que rompió el terremoto de magnitud 8.0 ocurrido en 1995) y dos áreas de alto acoplamiento entre placas tectónicas: la primera ubicada entre Taltal y Copiapó; y la segunda, entre Vallenar y La Serena.

Sobre este último punto, el profesor Francisco Ortega Culaciati recordó que “la laguna sísmica de Atacama ha sido afectada por los terremotos de 1819 y 1922, ambos separados por un rango de tiempo de casi 100 años”. Por esta razón, agregó el académico, “si bien no es posible predecir cuándo será el próximo gran terremoto en la zona, es razonable esperar que la energía acumulada desde 1922 sea liberada en algún momento en el futuro”.

La investigación para la tesis de magíster “Deformación intersísmica y acoplamiento interplaca a partir de datos GNSS en la brecha sísmica de la Región de Atacama” fue financiada por los proyectos Núcleo Milenio CYCLO y Fondecyt Regular 1181479. La segunda parte de este trabajo, que permitió elaborar el artículo “Interplate Coupling and Seismic Potential in the Atacama Seismic Gap (Chile): Dismissing a Rigid Andean Sliver”, contó además con el financiamiento del Proyecto Anillo PRECURSOR ACT-192168.